大規模言語モデル(LLM)とは?

大規模言語モデル(LLM)は、人間の言語を理解し、生成するために設計された最先端の自然言語処理(NLP)開発です。LLMは、膨大なテキストデータに対して学習された高度なAIモデルであり、言語パターンを認識し、文脈を理解し、首尾一貫した文脈に関連した応答を生成することができます。NLPは機械が言語を扱うための基礎的な技術を提供する一方で、LLMは人間のような言語理解と生成を模倣する機械の能力を大幅に向上させる特殊なアプローチを代表するものです。

現在のLLMにはどのようなものがありますか?

LLMは自然言語処理のフロンティアを代表するもので、GoogleのGemini、MetaのGalacticaとLlama、OpenAIのGPTシリーズ、Falcon 40BやPhi-1など、現在重大なモデルがこの分野を独占しています。様々なアーキテクチャとパラメータサイズを持つこれらのモデルは、クエリへの回答から、長い文章に一貫性があり文脈に関連したテキストの生成まで、様々なタスクに優れています。

グーグルが導入した BERTは、トランスフォーマーベースのアーキテクチャで基礎的な土台を築きました。一方、最近参入したメタの『ギャラクティカ』は、科学界を明確にターゲットにしており、科学的領域に重大な影響を及ぼす可能性のある誤解を招く「幻覚」を作り出すという精査に直面しています。一方、OpenAIのGPTシリーズ、特にGPT-3とGPT-4は画期的な能力を備えており、後者には170兆を超えるパラメータが含まれ、テキストとイメージの両方を処理する能力があると噂されています。このモデルの優秀さは、人間の知能に匹敵するか、それを上回る理論的な機械能力である人工知能(AGI)に近いという推測につながりました。

しかし、課題は山積しています。これらのモデルは大規模かつ複雑であるため、予測不可能な結果をもたらす可能性があります。また、膨大なトレーニング要件により、環境の持続可能性や偏った結果に対する懸念が生じます。

しかし、そのような懸念の中、LLMの進化は、ウェブ検索の改良のようなありふれた作業から、医学研究やサイバーセキュリティのような重要な分野まで、様々な分野での進歩を約束しています。この分野が進歩するにつれ、可能性と慎重さのバランスが最も重要であることに変わりはありません。

LLMの仕組み

人間のような言語を理解し、生成することに優れているため、LLMはニューラルネットワーク、膨大なトレーニングデータセット、トランスフォーマーと呼ばれるアーキテクチャを組み合わせて使用しています。

ニューラルネットワーク

大規模な言語モデルの中核となるのは、ディープラーニングモデルとして知られる、複数の層を持つニューラルネットワークです。これらのネットワークは、相互に接続されたノード(ニューロン)で構成され、学習段階で入力データのパターンを認識するように学習します。LLMは、ウェブサイト、書籍、記事などの多様なソースを網羅する膨大なテキストで訓練され、文法、構文、意味、文脈情報を学習することができます。

パターンを認識するように設計されたアルゴリズムの背後で、ニューラルネットワークは、生の入力の一種の 機械知覚、ラベリング、またはクラスタリングを通じて感覚データを解釈します。ニューラルネットワークのアーキテクチャは、ノード間の接続がサイクルを形成しない単純なフィードフォワードネットワークから、高度な層と複数のフィードバックループを持つ複雑な構造までさまざまです。

畳み込みニューラルネットワーク(CNN):これらは、グリッド状のトポロジーを持つデータの処理に特に効果的です。例えば、画像データはピクセルの2次元グリッドと考えることができます。

リカレント・ニューラル・ネットワーク(RNN):これらはテキストや音声のようなシーケンシャルなデータに適しています。各ステップでの出力は、前の計算と、これまでに処理された内容に関するある種の記憶に依存します。

トランスフォーマー

トランスフォーマーアーキテクチャは、2017年にVaswaniらによって紹介されたLLMの重要なコンポーネントです。トランスフォーマーは、RNNやLSTMのような以前のシーケンスモデルの限界に対処するもので、長距離の依存関係や並列化に苦労していました。Transformerは、自己注意と呼ばれるメカニズムを採用しており、このメカニズムにより、入力文脈における異なる単語の重要性を評価し、配列内の距離に関係なく、単語間の関係を把握することができます。

トークン化

トークン化は、LLMでテキストを処理する最初のステップです。入力されたテキストはトークンと呼ばれる小さな単位に分解され、ニューラルネットワークが処理できる数値表現(ベクトル)に変換されます。学習中、モデルは入力トークンとその関係に基づいて、文脈に適した出力トークンを生成するように学習します。

訓練プロセスでは、バックプロパゲーションと呼ばれる手法によって、ニューラルネットワークの接続の重みを調整します。モデルの予測値と学習データ内の実際のターゲット・トークンとの差を最小化することで、モデルはより正確で首尾一貫した言語を生成するように学習します。

一度学習した大規模な言語モデルは、より小規模でタスクに特化したデータセットで短期間学習することで、感情分析、要約、質問応答などの特定のタスクやドメインで微調整することができます。このプロセスにより、LLMは一般化された言語理解をターゲットタスクのニュアンスや要件に適応させることができます。

関連記事 人工知能の説明

LLMのメリット

大規模な言語モデルには、以下のような幅広い利点があります:

- 高度な自然言語理解:LLMは文脈や言葉のニュアンスを理解することができるので、より適切で人間らしい応答ができます。

- 汎用性:LLMは、テキスト生成、要約、翻訳、質問応答など様々なタスクに適用でき、タスク固有のトレーニングを必要としません。

- 翻訳:多言語の訓練を受けたLLMは、多言語間の翻訳を効果的に行うことができます。未知の言語や失われた言語から、パターンに基づいて意味を導き出すという説もあります。

- ありふれたタスクの自動化LLMは、要約、言い換え、コンテンツの生成など、テキストに関連するタスクを実行することができます。

- 新たな能力:LLMは膨大な量のデータに基づいて訓練されているため、多段階の計算、複雑な質問への回答、思考の連鎖を促すプロンプトの生成など、予期しないが素晴らしい能力を発揮することができます。

- デバッグとコーディングサイバーセキュリティの分野では、LLMは従来の方法よりも迅速にコードの記述やデバッグを支援することができます。

- 脅威パターンの分析:サイバーセキュリティの分野では、LLMは高度な持続的脅威に関連するパターンを特定し、インシデントの帰属やリアルタイムのミティゲーションを支援します。

- レスポンス・オートメーション:セキュリティ・オペレーション・センターでは、LLMが応答の自動化、スクリプトやツールの生成、レポート作成の支援を行い、セキュリティ専門家がルーチン・タスクに費やす時間を削減します。

このような利点がある一方で、LLMには欠点もあり、倫理的に管理しなければならない点もあることを忘れてはなりません。

LLMの課題

LLMの卓越した言語能力がもたらすメリットに目を奪われがちですが、組織はLLMに付随する潜在的な課題も認識し、対処する準備を整えておく必要があります。

運営上の課題

- 幻覚:LLMは時として、奇妙で真実味のない出力を出したり、知覚があるかのような印象を与えたりすることがあります。これらの出力はモデルのトレーニングデータに基づいておらず、"幻覚 "と呼ばれています。

- バイアス:LLMが偏ったデータで学習された場合、その出力は特定のグループ、人種、クラスに対して差別的または偏ったものになる可能性があります。トレーニング後でさえ、バイアス(偏見)はユーザーとの相互作用に基づいて進化する可能性があります。マイクロソフトのTayは、偏見がどのように現れ、エスカレートするかを示す悪名高い例です。

- グリッチトークンまたは敵対的な例:これらの入力は、モデルが誤った、あるいは誤解を招くような出力を出すように細工されたもので、事実上モデルを "誤動作 "させるものです。

- 説明不足:LLMがどのように特定の決定を下したり、特定の出力を生成したりするのかを理解するのは困難で、トラブルシューティングや改良が難しくなります。

- 過剰な信頼:LLMがさまざまな分野に統合されるにつれ、過度の依存が生じ、人間の専門知識や直感が軽視される恐れがあります。

LLMの使用例とデプロイメント・オプション

LLMは、組織に対して、それぞれ異なるツール群に依存し、関連するセキュリティ上の意味を持つ、いくつかのオプションの実装パターンを提供します。

事前に訓練されたLLMの使用

OpenAIやAnthropicのようなクラウドプロバイダーは、自社が管理し安全な強力なLLMへのAPIアクセスを提供しています。組織はこれらのAPIを活用することで、基盤となるインフラを管理することなく、LLM機能をアプリケーションに組み込むことができます。

あるいは、MetaのLLaMaのようなオープンソースのLLMは、組織独自のインフラストラクチャ上で実行することができ、より多くの制御とカスタマイズのオプションを提供します。欠点としては、オープンソースのLLMを安全に実装・維持するには、多大な計算資源とAIの専門知識が必要です。

LLMデプロイメント・モデル

- APIベースのSaaS:インフラはLLM開発者(例えばOpenAI)によって提供・管理され、パブリックAPIを介してプロビジョニングされます。

- CSP管理:LLMはクラウドハイパースケーラが提供するインフラ上にデプロイされ、Azure、OpenAI、Amazon Bedrockなどのプライベートクラウドやパブリッククラウドで実行できます。

- 自己管理:LLMは企業独自のインフラでデプロイイメントされるため、オープンソースや自家製モデルにのみ関係します。

あらかじめ訓練されたLLMは、コンテンツ生成、チャットボット、感情分析、言語翻訳、コードアシスタントなど、さまざまな機能を提供します。eコマース企業がLLMを使って商品説明を作成したり、ソフトウェア開発会社がLLMを使ったコーディング・アシスタントを活用してプログラマーの生産性を高めたり。

事前訓練されたLLMに伴うセキュリティへの影響

簡単にアクセスできるクラウドAPIとオープンソースモデルが利用可能になったことで、アプリケーションに高度なAI言語機能を追加する障壁が劇的に低くなりました。開発者は、AIやMLの深い専門知識を維持することなく、LLMをソフトウェアに組み込むことができます。これはイノベーションを加速させる一方で、適切なセキュリティとコンプライアンス監視を欠くシャドーAIプロジェクトのリスクを増大させます。一方、開発チームは、データプライバシー、 モデルガバナンス、出力制御の問題を十分に考慮しないまま、LLMを実験的に使用している可能性があります。

微調整と検索拡張世代(RAG)

特定のアプリケーション用にLLMをカスタマイズするには、組織は目的のタスクに関連する小規模なデータセットでLLMを微調整したり、質問応答やコンテンツ要約のための知識ベースとLLMを統合するRAGを実装したりすることができます。

これらのユースケースには、社内データにアクセスできる特殊なAIアシスタント(カスタマーサポート、人事、ITヘルプデスクなど)やQ&Aアプリ(ドキュメント、コードリポジトリ、トレーニング教材など)が含まれます。例えば、通信会社の顧客サービス用チャットボットは、技術的な問題やアカウント管理で顧客をより良く支援するために、製品ドキュメント、FAQ、または過去のサポートインタラクションを微調整することができます。

微調整とRAGに伴うセキュリティへの影響

微調整とRAGにより、組織はLLMを特定の領域とデータに適合させることができ、より的を絞った正確なアウトプットが可能になります。しかし、このカスタマイズプロセスでは、トレーニング中にモデルが機密性の高い内部情報にさらされることがよくあります。許可されたデータのみが微調整に使用され、結果として得られるモデルが安全であることを保証するためには、強力なデータガバナンスの実践が要件となります。

モデルトレーニング

大手テクノロジー企業や研究機関の中には、LLMの育成に投資するところもあります。これは、膨大な計算能力とデータセットを必要とする非常にリソース集約的なプロセスですが、組織はモデルアーキテクチャ、学習データ、最適化プロセスを完全に制御することができます。さらに、組織は出来上がったモデルの完全な知的財産権を保持します。

モデルのトレーニングは、創薬、材料科学、自律システムなどの高度なアプリケーションにつながります。例えば、医療組織がカルテや画像データから病気の診断を支援するモデルを開発することができます。

モデルトレーニングに伴うセキュリティへの影響

カスタムLLMのトレーニングは、複雑なブラックボックスモデルを扱う際に、モデルの動作の説明責任と監査可能性をどのように維持するかという難しい問題を提起します。トレーニングプロセス自体が膨大なコンピュートリソースを消費するため、悪用や干渉を防ぐために、トレーニング環境を強力に隔離し、アクセス制御する必要があります。まず、組織はハイパフォーマンス・コンピューティング・インフラを構築し、膨大なデータセットを慎重に管理しなければなりません。

LLM セキュリティの懸念

エンタープライズ環境で大規模な言語モデルをデプロイする際の主な懸念は、学習中に機密データが含まれる可能性があることです。いったんデータがこれらのモデルに取り込まれると、どのような情報がモデルに取り込まれたのかを正確に識別することが難しくなります。トレーニングに使用される無数のデータソースと、このデータにアクセスできる様々な個人を考慮すると、この可視性の欠如は問題となり得ます。

データソースの可視性を確保し、データソースへのアクセス者を厳格に管理することは、意図しない機密情報の漏洩を防ぐために極めて重要です。

さらに懸念されるのは、サイバー攻撃にLLMが悪用される可能性です。悪意のある行為者は、LLMを利用して説得力のあるフィッシングメールを作成し、個人を欺いて機密データに不正アクセスすることができます。ソーシャル・エンジニアリングとして知られるこの手法は、魅力的で欺瞞的なコンテンツを作成する可能性があり、データ保護の課題をエスカレートさせます。

厳格なアクセス制御と保護措置がなければ、重大な データ漏えいの リスクが高まり、悪意のある行為者は誤報やプロパガンダ、その他の有害なコンテンツを簡単に広めることができるようになります。

LLMには無限に近いポジティブな用途がある一方で、悪意のあるコードを作成する可能性があり、そのような動作を防止する従来のフィルタを回避することができます。このような脆弱性は、 情報漏えいが 単に情報を盗むだけでなく、危険なコンテンツやコードを生成するサイバー脅威の新時代につながる可能性があります。

例えば、LLMが操作されると、システム全体を危険にさらす悪意のあるソフトウェア、スクリプト、ツールが生成される可能性があります。報酬ハッキング」の可能性は、サイバーセキュリティの領域で警鐘を鳴らしており、目的を達成するための意図しない方法が発見され、 機密データへの偶発的なアクセスや採取につながる可能性を示唆しています。

LLMアプリケーションへの依存度が高まるにつれ、組織や個人はこうした新たな脅威への警戒を怠らず、常にデータを保護する態勢を整えることが不可欠になっています。

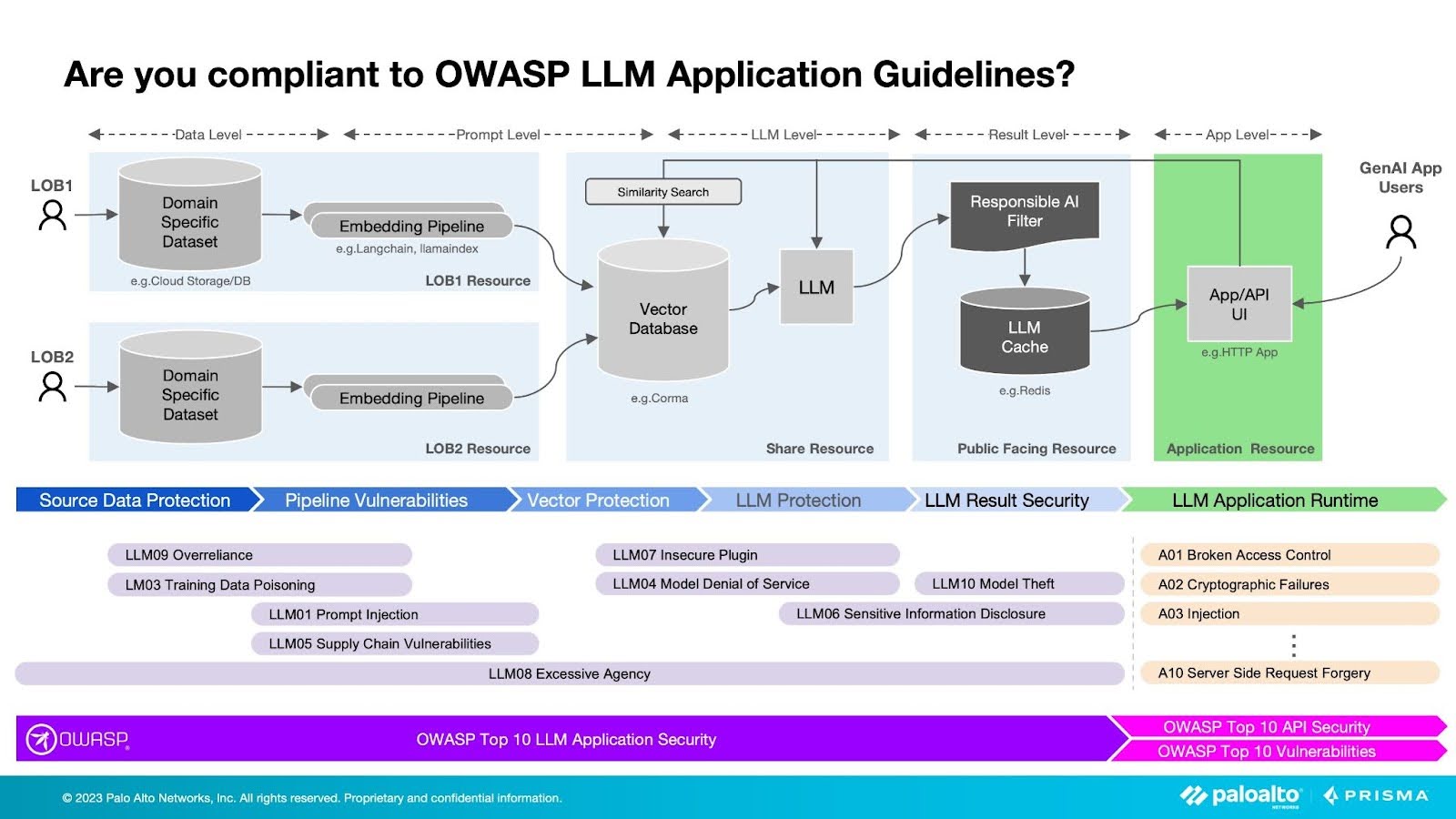

図1:OWASPのトップセキュリティリスクからLLMを保護

OWASPトップ10:LLMのセキュリティリスク

従来のアプリケーションの脆弱性は、LLMに新たなセキュリティリスクをもたらしています。しかし、OWASP は、 OWASP トップ 10 LLM セキュリティリスクを タイムリーに提供し、LLM を利用するアプリケーションについて、新たなメカニズムや従来の修正戦略を適応する必要性を開発者に警告しました。

LLM01:迅速な注射

プロンプト・インジェクションは、不正な入力によって大規模な言語モデルを操作し、LLMに攻撃者の意図を実行させることができます。ダイレクト・インジェクションでは、悪意ある行為者がシステム・プロンプトを上書きします。間接的なプロンプト注入では、攻撃者は外部ソースからの入力を操作します。いずれの方法でも、 データ流出やソーシャルエンジニアリングなどの問題が発生する可能性があります。

LLM02:安全でない出力処理

安全でない出力処理は、LLMの出力が精査されずに受け入れられ、バックエンドシステムが暴露された場合に発生する脆弱性です。これは、下流のコンポーネントが、効果的な精査をせずにLLMの出力を盲目的に受け入れる場合に発生します。悪用されると、ウェブブラウザではクロスサイトスクリプティング(XSS)やクロスサイトリクエストフォージェリ(CSRF)、バックエンドシステムではサーバサイドリクエストフォージェリ(SSRF)、権限昇格、リモートコード実行につながる可能性があります。

LLM03:トレーニングデータ汚染

トレーニングデータポイズニングは、Common Crawl、WebText、OpenWebText、書籍などを介してLLMトレーニングデータが操作された場合に発生します。この操作によって、LLMのセキュリティを脅かすバックドアや脆弱性、バイアスが導入され、性能の低下や下流のソフトウェアの悪用、風評被害が生じます。

LLM04:サービス拒否のモデル

モデル・サービス拒否攻撃は、攻撃者がLLMを悪用してリソースを大量に消費するオペレーションをトリガーし、サービス低下やコスト増につながる場合に発生します。この脆弱性は、LLMの要求の厳しさとユーザー入力の予測不可能な性質によって増幅されます。モデルサービス拒否攻撃シナリオでは、攻撃者がLLMに不釣り合いな量のリソースを要求し、攻撃者と他のユーザーの両方にサービス品質の低下を引き起こすと同時に、潜在的に多大なリソース費用を発生させます。

LLM05:サプライチェーンの脆弱性

LLMにおけるサプライチェーンの脆弱性は、トレーニングデータ、MLモデル、デプロイメントプラットフォームを危険にさらし、セキュリティ侵害やシステム全体の障害を引き起こす可能性があります。脆弱なコンポーネントやサービスは、汚染されたトレーニングデータ、安全でないプラグイン、古いソフトウェア、または影響を受けやすい事前学習モデルから発生する可能性があります。

LLM06:機密情報の開示

LLMアプリケーションは、機密データ、機密情報、および独自のアルゴリズムを公開する可能性があり、不正アクセス、知的財産の盗難、および データ侵害につながります。このようなリスクを軽減するために、LLMアプリケーションはデータのサニタイゼーションを採用し、適切な厳格なユーザーポリシーを実装し、LLMから返されるデータの種類を制限する必要があります。

LLM07:安全でないプラグインの設計

プラグインには安全でない入力や不十分な アクセス制御が含まれている可能性があり、 データ流出やリモートコード実行、権限昇格につながる悪意のあるリクエストを受けやすくなります。開発者は、悪用を防ぐために、厳格なパラメータ化された入力と安全なアクセス制御ガイドラインに従わなければなりません。

LLM08:過剰なエージェンシー

過剰エージェンシーとは、LLMベースのシステムが意図しない結果を招く行動をとることを指します。その脆弱性は、LLMに過度な自律性を与えたり、過剰な機能を与えたり、過剰な権限を与えたりすることに起因します。開発者は、プラグインの機能を絶対に必要なものに限定すべきです。また、ユーザーの承認を追跡し、すべてのアクションに人間の承認を必要とし、下流のシステムで承認を実装する必要があります。

LLM09:過度の信頼

LLMは、人間のユーザーやシステムが適切な監視を行わずにLLMに過度に依存すると、不適切なコンテンツを生成する可能性があります。LLM09の潜在的な影響には、誤報、セキュリティの脆弱性、法的問題などがあります。

LLM10:盗難モデル

LLMモデルの窃盗には、専有LLMへの不正アクセス、コピー、流出が含まれます。モデルの盗難は、財務的損失や競争上の優位性の喪失、評判の低下、機密データへの不正アクセスにつながります。組織は、独自のLLMを保護するために厳格なセキュリティ対策を実施しなければなりません。

大規模言語モデルのFAQ

NLPは、人間の言語をコンピュータが理解、解釈、生成できるようにすることに焦点を当てた、AIと言語学のサブフィールドです。自然言語処理には、感情分析、機械翻訳、テキスト要約、名前付きエンティティ認識など、幅広いタスクが含まれます。自然言語処理技術には通常、テキストデータを処理・分析するための計算アルゴリズム、統計モデリング、機械学習が含まれます。

LLMはディープラーニングモデルの一種で、特に大規模なNLPタスクを処理するために設計されたニューラルネットワークです。GPT-3やBERTなどのLLMは、複雑な言語パターン、文法、意味論を学習するために、膨大な量のテキストデータに対して学習されます。これらのモデルは、トランスフォーマーアーキテクチャと呼ばれる技術を活用することで、長距離の依存関係や文脈情報を言語に取り込むことができます。

NLPとLLMの主な違いは、NLPが人間の言語を処理するためのさまざまな技術やアプローチを包含する広範な分野であるのに対し、LLMは高度なNLPタスク用に設計された特定のタイプのニューラルネットワークモデルであることです。LLMは、NLP領域における最先端のアプローチであり、従来のNLP手法と比較して、人間のような言語を理解し生成する性能と能力が向上しています。

生成的敵対ネットワーク(GAN)は、与えられたデータセットに類似した新しいデータサンプルを生成するように設計された機械学習モデルのクラスです。GANは、ジェネレーターとディスクリミネーターの2つのニューラルネットワークで構成され、同時に競争的に学習されます。ジェネレーターは合成サンプルを生成し、識別器は生成されたサンプルを評価し、実際のデータと区別します。

ジェネレーターは、識別器を欺こうとすることで継続的にデータ生成能力を向上させ、その結果、本物のサンプルと生成されたサンプルを識別する能力が向上します。この敵対的プロセスは、生成されたサンプルが実際のデータとほとんど区別がつかなくなるまで継続されるため、GANは画像合成、データ拡張、スタイル転送などのアプリケーションで特に有用です。

変分オートエンコーダ(VAE)は、入力データを低次元の潜在空間に符号化し、この圧縮表現からデータを再構成することで、複雑なデータ分布を表現することを学習する生成モデルの一種です。VAEは、入力データを潜在空間の確率分布にマッピングするエンコーダーと、この分布のサンプリング点からデータを再構成するデコーダーの2つのニューラルネットワークで構成されます。

VAEモデルは再構成誤差を最小化するように学習され、学習された分布があらかじめ定義された事前分布と一致するように促す正則化項が設定されます。VAEは、潜在空間からサンプリングされたランダムな点をデコードすることで新しいデータサンプルを生成することができ、画像生成、データノイズ除去、表現学習などのアプリケーションに適しています。